Les notes de Quantmetry sur Viva Technology 2019

Entre les 16 et 18 mai derniers se tenait à Paris Expo la quatrième édition de Viva Technology. Salon dédié à l’innovation dans son sens le plus large ! Géants de la Tech et startups (près de 13 000 disposaient d’un stand) s’y retrouvaient pour faire démonstration de leur activité, de leurs idées et de leurs ambitions. Présent parmi eux, Quantmetry s’est frayé un chemin entre les quelques 124 000 visiteurs de VivaTech pour prendre la température de l’évènement.

Lors de cette édition, Sodexo nous a invité à tenir un stand dans leur espace, ainsi qu’à participer à leur table ronde « Return on experience : data & AI revolution is here, how to grasp this massive opportunity ? », au cours de laquelle Thibault Chanut, directeur chez Quantmetry a pu exprimer certaines de nos convictions sur ce sujet.

La sélection des bons use cases est déterminante. Les décideurs sont confrontés à de très nombreuses possibilités en data science, face auxquelles il est important de garder le ROI et la maîtrise du risque comme premiers critères de sélection. Les use cases peuvent se classer en deux catégories : augmentation du revenu ou optimisation des coûts. Souvent, la deuxième catégorie donne des solutions dont les ROI sont mesurables plus rapidement.

Des use cases intéressants émergent sur l’analyse de marchés ou le marketing intelligence, en utilisant des données externes à l’entreprise. Ainsi, un représentant d’Eramet explique lors de cette table ronde que des images satellites de mines permettent d’estimer la quantité de matière première extraite, donc d’en anticiper la quantité disponible et les prix sur le marché.

Enfin, Thibault a tenu à rappeler l’importance que représente le travail sur la qualité et la documentation de la donnée. Ce travail demeure un accélérateur clé pour tous les projets de data science.

Sodexo et Quantmetry à VivaTech

Sodexo et Quantmetry à VivaTech

Les géants de la Tech

Alibaba Cloud

Outre son CEO Jack Ma, Alibaba était largement représenté lors de la journée d’ouverture, animant une demi-douzaine de talks notamment quant à la stratégie autour de son cloud.

Soucieux de demeurer fidèle à la pro-activité caractéristique du groupe, Alibaba Cloud compte bien poursuivre son développement en améliorant son offre en Europe, au Moyen Orient et en Afrique. Dans cette optique, Yeming Wang, General Manager à Alibaba Cloud EMEA, a annoncé qu’Alibaba Cloud a trouvé des accords avec neuf nouveaux partenaires venus rejoindre l’EMEA Ecosystem Partner Program.

Fort de cette activité, le numéro trois des IaaS peut poursuivre d’accroître son influence dans le retail, tendant ainsi davantage vers son objectif de proposer un marché data-driven intégralement en ligne, dont toutes les applications se feraient sur le cloud et auraient recours à de l’Intelligence Artificielle dévouée au client.

Microsoft : La santé assistée par l’Intelligence Artificielle

Parmi les nombreux talks assurés par Microsoft Services, l’un d’eux proposait la vision de Microsoft quant à l’horizon des applications possibles de l’Intelligence Artificielle dans le domaine de la santé.

L’objectif ne serait en rien de révolutionner le système sanitaire mais plutôt de pérenniser les structures déjà en place en ayant recours au potentiel de l’Intelligence Artificielle. Optimisation des budgets de fonctionnement des caisses de santé, détection automatisée des fraudes, amélioration de la performance de la recherche clinique et de son financement, nouveaux outils médicaux … sont autant d’opportunités envisageables.

Projetons-nous dans un avenir (pas si lointain) et voyons ce que permettrait un système sanitaire entièrement digitalisé. Une personne sur le point de faire un infarctus verrait sa montre connectée alerter immédiatement l’unité de cardiologie la plus proche. Une ambulance emprunterait alors le chemin le plus rapide (calculé en temps réel) afin de traiter le patient dans les meilleurs délais. Tout au long de sa période d’hospitalisation, le dossier médical du patient serait automatiquement mis à jour et agrémenté des dates des rendez-vous médicaux (consultation d’un radiologue par le biais d’une HoloLens) et des résultats des examens complémentaires (voire prévisionnels) qu’il aura à effectuer.

Microsoft veut se positionner comme un incontournable dans la digitalisation des parcours santé individualisés et s’efforce de produire un service systémique qui ira de la collecte des données de santé à leur traitement automatique.

Présentation Health and AI : Past, Present and Future of AI usage in Health par Microsoft Services

Présentation Health and AI : Past, Present and Future of AI usage in Health par Microsoft Services

IBM : NeuNetS

Les géants du web ont lancé la course à l’automatisation du Machine Learning ! Dans ce sens, lors d’une de ses conférence à Vivatech, IBM a présenté NeuNets: un outil permettant de choisir l’architecture optimale de son réseau de neurones sans programmation et en un temps réduit. Magie.

Sous le capot, NeuNetS fonctionne sur un environnement entièrement conteneurisé déployé sur le cloud IBM avec Kubernetes. Tout est automatisé, de l’ingestion et prétraitement du jeu de données à la formation et recherche d’architecture optimale et finalement le déploiement du modèle.

NeuNetS est conçu pour créer de nouveaux réseaux de neurones sans réutiliser des modèles pré-entraînés. Il comprend des versions améliorées de travaux récemment publiés, tels que TAPAS et NCEvolve , ainsi qu’un moteur d’optimisation basé sur un algorithme génétique. TAPAS est un synthétiseur de réseaux de neurones utilisant le transfer learning tandis que NCEvolve synthétise les réseaux les plus performants en minimisant le temps de formation.

Finalement, la conception de réseaux de neurones étant plus expérimentale que théorique, il n’est pas étonnant qu’un tel outil voie le jour. À la vue des performances publiées dans le papier de recherche dédié [1], il sera intéressant de voir les réponses de AWS, Azure et Google Cloud.

IBM Watson : Détection de la silhouette d’un individu

[1] https://arxiv.org/pdf/1901.06261.pdf

Nos coups de coeur

Embodme #ComputerVision #IAEmbarquée

Une rencontre a retenu notre attention lors du salon, celle avec Embodme, start-up qui se propose de révolutionner la création musicale avec un synthétiseur d’un genre nouveau. Moins de boutons, de touches ou de « potards » : une caméra infrarouge capte le mouvement des mains du musicien dans l’air et en temps réel, lui permettant de créer de manière plus spontanée.

La prouesse technique réside dans la partie temps réel. En effet, un algorithme de Computer vision à réseaux de neurones détecte les mains du musicien, en identifie les parties pour créer un polygone en 3 dimensions (doigts, phalanges, paume…). Ensuite, les déformations de ce polygone sont traduites en commandes musicales : augmenter la réverbération en levant le petit doigt ou encore augmenter les basses d’un mouvement du poignet. Expérience utilisateur oblige, toutes ces étapes doivent tenir en une durée de l’ordre de la milliseconde.

Labsense #NLP #GénérationDeContenu

Cette année, le groupe TF1 sortait lui aussi les grands moyens avec son MediaLab. Autour d’une réplique de son plateau du 20h dopée à la réalité augmentée, une trentaine de start-ups exposaient leurs travaux autour de thématiques média : AdTech, VR, chatbots, assistants vocaux, production automatique de contenu.

Nous y avons rencontré LabSense, petite entreprise forte de sept années de R&D autour du NLP, une discipline qui nous est chère. Leur proposition de valeur est de permettre aux rédacteurs de se concentrer sur les tâches à valeur ajoutée, nous retenons notamment deux use cases intéressants de nos échanges :

Production automatique de texte. En fournissant un jeu de donnée structuré, leur algorithme sait créer automatiquement un texte factuel rédigé au format d’un article. Cela permet notamment de couvrir des sujets de niche qui seraient peu traités aujourd’hui.

Résumé de texte : LabSense propose une solution de synthèse d’avis clients. Objectif annoncé : produire des textes simples, utiles aux consommateurs mettant en avant les produits de leurs clients.

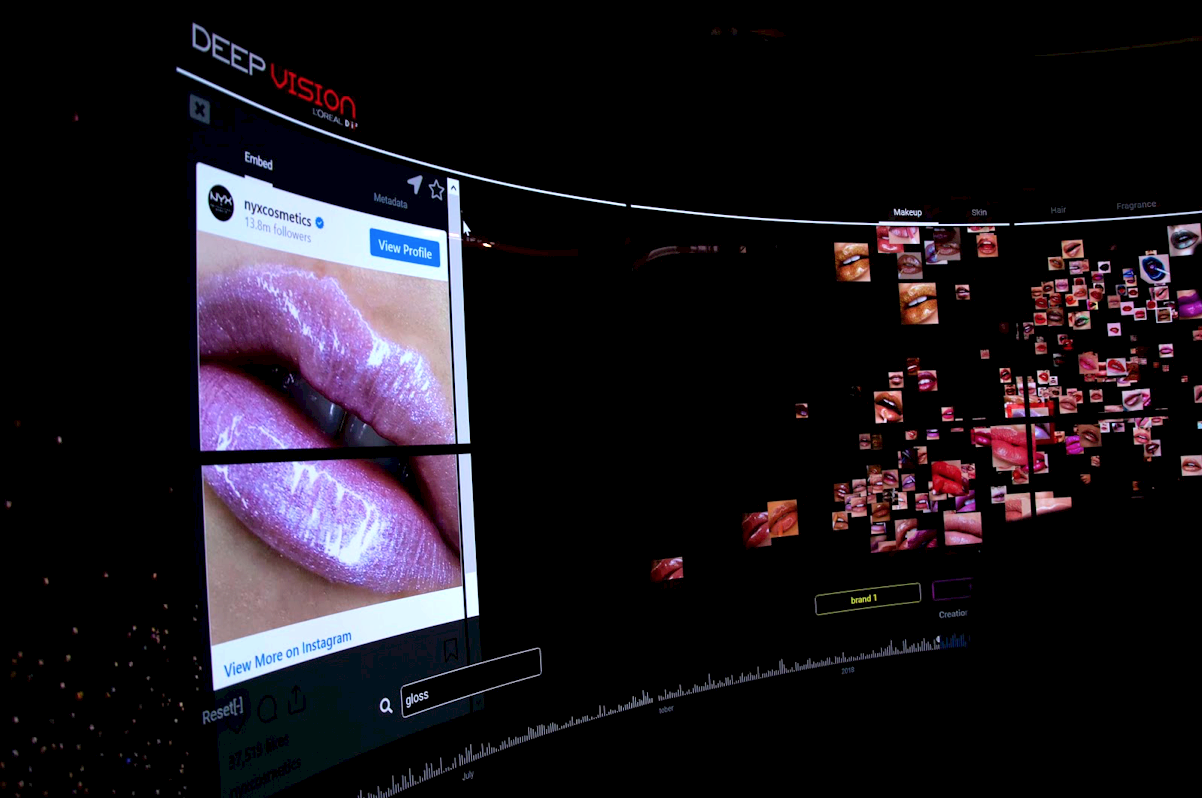

L’Oréal #ComputerVision #DataViz

Cette année L’Oréal faisait dans le sensationnel pour présenter ses innovations digitales et IA. Une cabine de 20m2 avec un écran à 360º permettant d’identifier les tendances makeup. Mode d’emploi :

Avec l’API Instagram Graph permettant de récupérer les images et métadonnées des comptes Instagram Business, l’équipe Data Science de L’Oréal récupère les photos publiées sur les comptes business des entreprises de beauté et d’identifier les photos de maquillage. Un algorithme de clustering leur permet de distinguer les images de bouches, d’yeux, ou de teint, de déterminer quels produits de makeup sont utilisés, d’en distinguer les couleurs, de récupérer le nombre de likes etc.

Les images sont réparties dans un espace 3D à l’aide d’un algorithme de réduction de dimension type t-SNE.

La dataviz prend ensuite tout son sens avec le gigantesque écran à 360º qui affiche simultanément des centaines d’images. Les analystes n’ont plus qu’à naviguer dans cet océan de make up pour détecter les tendances.

Clustering 3D de photos Instragram de gloss dans la capsule IA de L’Oréal

Clustering 3D de photos Instragram de gloss dans la capsule IA de L’Oréal